作為中國領(lǐng)先的互聯(lián)網(wǎng)科技企業(yè),騰訊的業(yè)務(wù)版圖覆蓋社交、游戲、金融、廣告、云服務(wù)等諸多領(lǐng)域,每日產(chǎn)生的數(shù)據(jù)量級達到PB甚至EB級別。面對海量數(shù)據(jù)的實時分析與高效存儲需求,騰訊在眾多技術(shù)棧中,選擇并深度應(yīng)用了ClickHouse這一開源的列式數(shù)據(jù)庫管理系統(tǒng),將其作為數(shù)據(jù)處理與存儲服務(wù)體系中的關(guān)鍵一環(huán)。

一、 選型背景:為何是ClickHouse?

騰訊的數(shù)據(jù)場景具有典型的“大數(shù)據(jù)”特征:數(shù)據(jù)體量巨大、增長迅速、查詢分析需求復雜且要求低延遲。傳統(tǒng)的Hadoop生態(tài)雖然在批處理上表現(xiàn)穩(wěn)健,但在實時交互式查詢方面存在瓶頸。而ClickHouse憑借其卓越的性能脫穎而出:

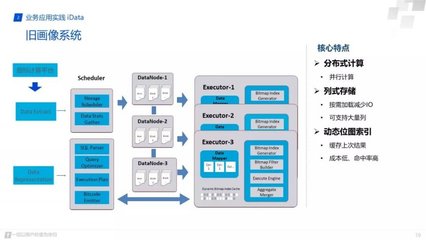

- 極致的查詢速度:列式存儲、向量化執(zhí)行引擎、豐富的預聚合能力(如AggregatingMergeTree),使得即使對上億行數(shù)據(jù)進行聚合查詢也能在亞秒級返回結(jié)果。

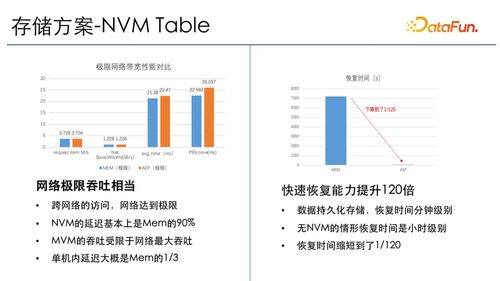

- 高效的數(shù)據(jù)壓縮:列式存儲天然適合壓縮,大幅降低了騰訊的存儲成本,這對于保存海量歷史數(shù)據(jù)(如用戶行為日志、游戲運營數(shù)據(jù))至關(guān)重要。

- 強大的實時寫入與吞吐能力:能夠支持高并發(fā)的數(shù)據(jù)插入,很好地對接了騰訊各業(yè)務(wù)線的實時數(shù)據(jù)流。

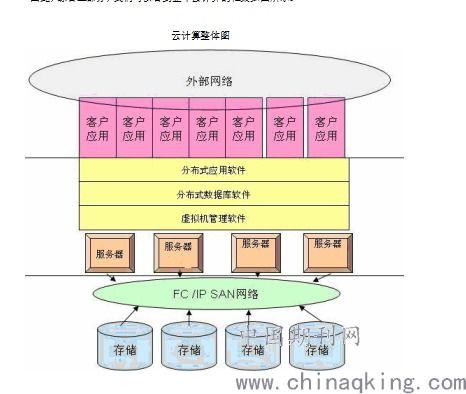

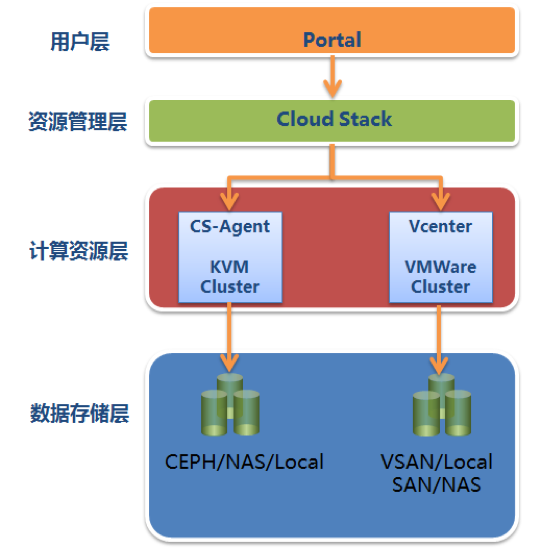

- 靈活的分布式架構(gòu):易于構(gòu)建集群,實現(xiàn)水平擴展,滿足騰訊業(yè)務(wù)不斷增長的數(shù)據(jù)處理需求。

二、 核心應(yīng)用場景與實踐

在騰訊內(nèi)部,ClickHouse的應(yīng)用已滲透到多個核心業(yè)務(wù)場景:

1. 實時監(jiān)控與運維分析:

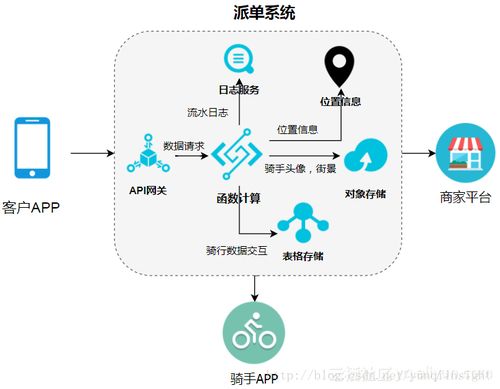

騰訊云及內(nèi)部眾多服務(wù)的服務(wù)器指標、應(yīng)用性能監(jiān)控(APM)數(shù)據(jù)、日志流被實時攝入ClickHouse。運維團隊和開發(fā)人員可以快速查詢特定時間區(qū)間、特定服務(wù)或主機的性能指標,進行故障定位和性能瓶頸分析,實現(xiàn)了從“事后復盤”到“實時洞察”的運維模式升級。

2. 用戶行為分析與廣告效果追蹤:

在微信、QQ等社交產(chǎn)品及各類游戲中,用戶的行為事件(如點擊、瀏覽、付費)被實時收集并寫入ClickHouse。數(shù)據(jù)分析師和業(yè)務(wù)運營人員能夠通過靈活的SQL,近乎實時地分析用戶畫像、漏斗轉(zhuǎn)化、功能使用熱度以及廣告投放的點擊率、轉(zhuǎn)化率和投資回報率(ROI),為產(chǎn)品迭代和精準營銷提供即時數(shù)據(jù)支撐。

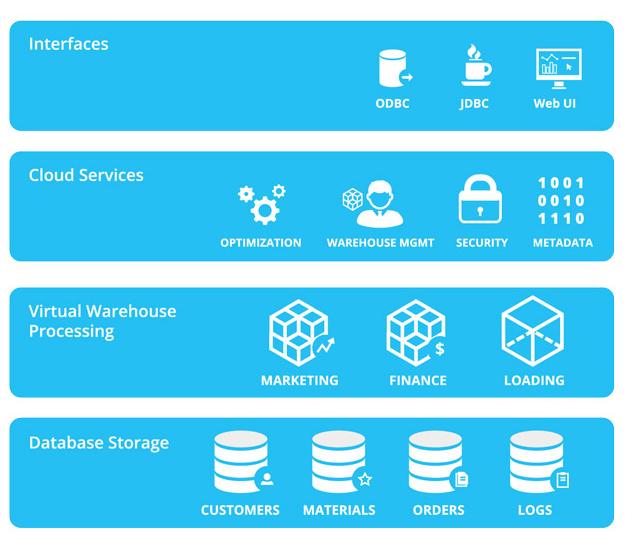

3. 大數(shù)據(jù)OLAP查詢引擎:

騰訊將ClickHouse作為數(shù)據(jù)倉庫(Data Warehouse)和數(shù)據(jù)分析平臺的核心查詢引擎之一。來自不同業(yè)務(wù)線的結(jié)構(gòu)化數(shù)據(jù),經(jīng)過ETL處理后導入ClickHouse,供各業(yè)務(wù)部門進行復雜的即席查詢(Ad-hoc Query)、多維分析(OLAP)和報表生成,大大提升了數(shù)據(jù)決策的效率。

4. 物聯(lián)網(wǎng)(IoT)數(shù)據(jù)處理:

在智慧城市、車聯(lián)網(wǎng)等IoT相關(guān)業(yè)務(wù)中,海量設(shè)備產(chǎn)生的時序數(shù)據(jù)(時間序列數(shù)據(jù))持續(xù)寫入ClickHouse。其針對時序數(shù)據(jù)優(yōu)化的表引擎(如MergeTree系列),能夠高效處理這類數(shù)據(jù)的存儲、聚合和按時間范圍的快速檢索。

三、 騰訊的深度優(yōu)化與最佳實踐

在規(guī)模化應(yīng)用過程中,騰訊的技術(shù)團隊對ClickHouse進行了深度調(diào)優(yōu)和定制,形成了獨特的最佳實踐:

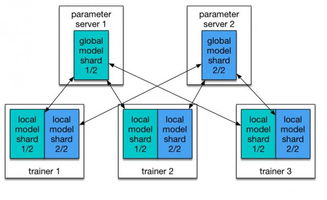

1. 集群架構(gòu)與數(shù)據(jù)分片:

根據(jù)業(yè)務(wù)數(shù)據(jù)量和查詢模式,設(shè)計合理的分片(Shard)與副本(Replica)策略。例如,按時間或業(yè)務(wù)ID進行分片,實現(xiàn)數(shù)據(jù)的分布式存儲與查詢的并行執(zhí)行,同時利用多副本機制保障數(shù)據(jù)高可用。

2. 與大數(shù)據(jù)生態(tài)的深度融合:

將ClickHouse無縫集成到騰訊的大數(shù)據(jù)平臺中。例如,使用Apache Kafka或騰訊自研的TDMQ作為數(shù)據(jù)管道,實現(xiàn)流式數(shù)據(jù)的實時攝入;利用Spark或Flink進行復雜的數(shù)據(jù)預處理和清洗后再導入ClickHouse;或?qū)lickHouse的查詢結(jié)果對接至BI工具(如Tableau、騰訊云BI)進行可視化展示。

- 性能調(diào)優(yōu)與成本控制:

- 索引優(yōu)化:精心設(shè)計主鍵和跳數(shù)索引(GRANULARITY),以加速最常見查詢條件的過濾。

- 表結(jié)構(gòu)設(shè)計:根據(jù)查詢模式選擇最合適的表引擎(如ReplacingMergeTree用于去重,SummingMergeTree用于預聚合),并合理定義分區(qū)鍵(PARTITION BY)。

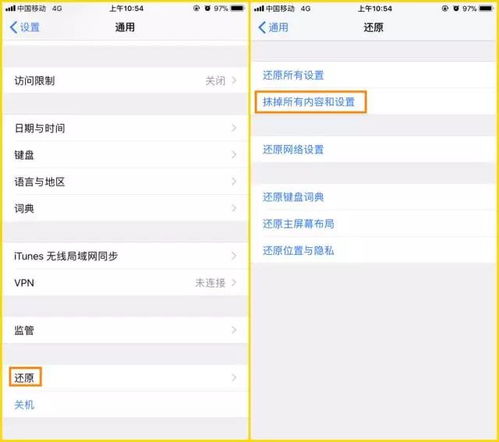

- 資源隔離與查詢管理:通過配置設(shè)置,對不同重要性的查詢進行資源隊列管理,防止重型查詢拖垮整個集群,保障核心業(yè)務(wù)的查詢SLA。

- 冷熱數(shù)據(jù)分層存儲:結(jié)合騰訊云對象存儲(COS)等廉價存儲,將訪問頻率低的冷數(shù)據(jù)從ClickHouse本地磁盤歸檔至COS,并通過外部表或集成表引擎進行查詢,顯著降低綜合存儲成本。

4. 監(jiān)控與高可用保障:

建立了完善的ClickHouse集群監(jiān)控體系,覆蓋節(jié)點狀態(tài)、查詢耗時、資源使用率、副本同步延遲等關(guān)鍵指標。通過自動化運維平臺實現(xiàn)故障節(jié)點的快速發(fā)現(xiàn)與替換,確保服務(wù)的持續(xù)穩(wěn)定。

四、 挑戰(zhàn)與未來展望

盡管ClickHouse表現(xiàn)卓越,騰訊在應(yīng)用中也面臨一些挑戰(zhàn),例如復雜多表關(guān)聯(lián)查詢的性能優(yōu)化、在高并發(fā)點查詢場景下的表現(xiàn)等。對此,騰訊一方面持續(xù)跟進ClickHouse社區(qū)的最新進展(如對JOIN算法的持續(xù)優(yōu)化),另一方面也結(jié)合自身業(yè)務(wù)特點進行內(nèi)部改進。

隨著騰訊業(yè)務(wù)數(shù)據(jù)量的持續(xù)爆炸式增長和實時性要求的不斷提高,ClickHouse作為其數(shù)據(jù)處理與存儲服務(wù)架構(gòu)中的“利刃”,將繼續(xù)發(fā)揮關(guān)鍵作用。騰訊也將繼續(xù)深化其在云原生部署、存算分離架構(gòu)、與機器學習平臺整合等方面的探索,推動ClickHouse在更廣泛的場景下釋放數(shù)據(jù)價值,賦能業(yè)務(wù)創(chuàng)新與增長。

ClickHouse在騰訊的成功實踐,證明了其在應(yīng)對超大規(guī)模互聯(lián)網(wǎng)企業(yè)實時數(shù)據(jù)分析挑戰(zhàn)上的強大能力。騰訊通過科學的選型、深入的場景化應(yīng)用和持續(xù)的優(yōu)化創(chuàng)新,不僅提升了自身數(shù)據(jù)驅(qū)動決策的效率,也為業(yè)界提供了可借鑒的大數(shù)據(jù)技術(shù)實戰(zhàn)范本。